联邦学习(Federated Learning)是一种分布式机器学习技术,它可以在不共享数据的情况下训练模型。这种技术在多个参与方之间协作构建共享的预测模型,同时保持每个参与方的数据本地化,不暴露给其他方。联邦学习特别适用于数据隐私敏感的场景,如医疗、金融和移动设备等。

定义

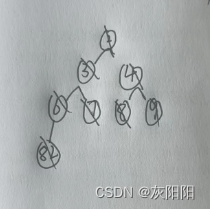

联邦学习是一种机器学习设置,其中多个客户端(例如,移动设备或整个组织)协作训练模型,而不需要将数据集中存储。相反,每个客户端使用其本地的数据来训练本地模型,并通过加密的方式将模型的更新(梯度或权重)发送到服务器。服务器聚合这些更新以构建全局模型,而无需访问任何客户端的原始数据。

原理

联邦学习的核心原理包括以下几个步骤:

- 初始化:服务器初始化全局模型,并将其发送到各个客户端。

- 本地训练:每个客户端使用自己的数据训练本地模型,并通过优化算法(如梯度下降)更新模型参数。

- 模型更新上传:客户端将模型的更新(通常是梯度或权重的小增量)加密上传到服务器。

- 聚合更新:服务器收到所有客户端的模型更新后,对它们进行聚合(例如,平均加权),以更新全局模型。

- 模型分发:服务器将聚合后的全局模型发送回各个客户端。

- 重复迭代:上述过程重复进行,直到全局模型收敛或达到预定的训练轮数。